Die Belastung von Rechenzentren verstehen: Vom Energiebedarf der KI zur Netzstabilität

Was passiert, wenn die künstliche Intelligenz mehr Strom verbraucht als ein Teil des Gesamtenergieverbrauchs der gesamten Nation pro Jahr? Ja, wir sprechen hier von etwa hunderttausend Terawattstunden pro Jahr. Es wird erwartet, dass KI etwa 20 Prozent des Strombedarfs von Rechenzentren ausmachen wird.

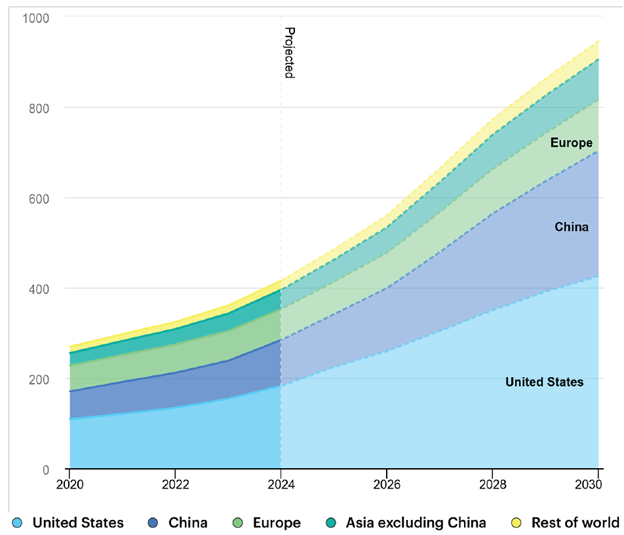

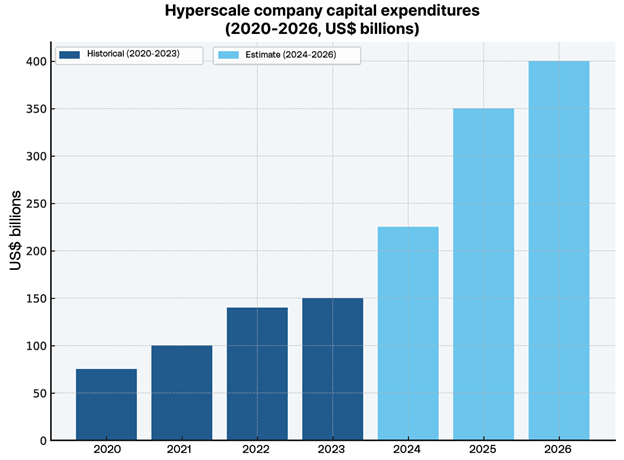

Der Strombedarf, der durch die Verbreitung von KI-fokussierten Rechenzentren entsteht, steigt. Prognosen zufolge wird er sich mehr als verdoppeln, von 415 TWh im Jahr 2024 auf über 945 TWh im Jahr 2030, was Rechenzentren zu einer der am schnellsten wachsenden Stromverbrauchsquellen in fortgeschrittenen Volkswirtschaften macht. Beim Wettlauf um die Skalierung von KI geht es nicht mehr nur um das Training größerer Modelle, sondern auch um Energie. Rechenzentren, die einst das stille Rückgrat der digitalen Wirtschaft waren, stehen nun im Mittelpunkt der globalen Energiedebatten. Untersuchungen von Goldman Sachs gehen davon aus, dass die fünf größten US-Hyperscale-Unternehmen in den Jahren 2025 und 2026 zusammen 736 Milliarden US-Dollar an Investitionsausgaben haben werden. Das ist nicht nur eine Statistik, sondern ein Weckruf.

Die versteckte Herausforderung: Leistungsschwankungen bei KI-Workloads

Die Probleme mit der Energieverwaltung bei großen KI-Trainingsworkloads betreffen Zehntausende von GPUs. Eine herkömmliche Google-Suche verbraucht etwa 0,3 Wattstunden (Wh); eine Abfrage mit einer KI-Funktion wie ChatGPT oder einer KI-gestützten Google-Antwort kann jedoch bis zu zehnmal so viel Strom verbrauchen, zwischen 2,9 und 3,6 Wattstunden oder mehr, je nach Aufgabe und verwendetem Modell. Zum Vergleich: Google verarbeitet stündlich etwa 571 Millionen Suchanfragen (≈158.548 pro Sekunde), während ChatGPT allein etwa 104 Millionen Anfragen pro Stunde (≈2,5 Milliarden pro Tag) verarbeitet, wie Axios berichtet. Dieser enorme Energiebedarf konzentriert sich nicht auf einen Standort, sondern verteilt sich auf Hunderte von Hyperscale- und Unternehmensrechenzentren weltweit, die jeweils riesige Flotten von Servern und GPUs betreiben. Das bedeutet, dass der Energiebedarf von KI-gesteuerten Suchvorgängen selbst bei einer geringeren Anzahl von Abfragen insgesamt schnell den von herkömmlichen Suchvorgängen übersteigen kann. Der höhere Energieverbrauch bei KI-Suchen ist auf die komplizierten Berechnungen zurückzuführen, die für generative KI-Modelle erforderlich sind, im Gegensatz zur einfacheren Informationsbeschaffung bei der klassischen Suche.

Netzstabilität in Gefahr

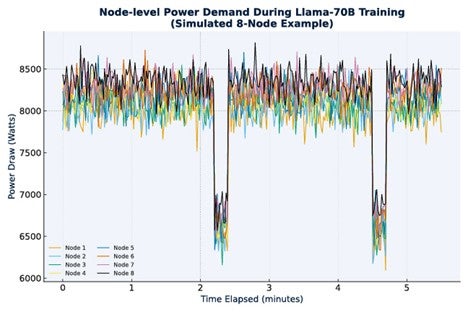

Es gibt eine rechenintensive Phase, in der jede GPU an den lokalen Daten arbeitet, und eine kommunikationsintensive Phase, in der sich alle GPUs über die Daten synchronisieren, da diese Aufträge synchron sind. Es kommt zu großen Leistungsschwankungen, da rechenintensive Phasen viel mehr Strom verbrauchen als Kommunikationsphasen. Mit zunehmender Anzahl von Trainingsaufträgen steigt auch die Amplitude dieser Leistungsschwankungen. Der Frequenzbereich dieser Leistungsschwankungen stellt eine noch größere Schwierigkeit dar (siehe Abbildung 3 für Llama), da er das Potenzial hat, die Infrastruktur des Stromnetzes physisch zu stören, wenn er mit den Grundfrequenzen der Versorgungsunternehmen zusammenfällt. Daher müssen wir die Leistung solcher Workloads stabilisieren.

Typische Rechenzentrumslast: Kühlung, Backup und komplexe Leistungselektronik

Jedes Rechenzentrum enthält mehrere Server, die bei der Verarbeitung von Daten eine große Menge an Wärme erzeugen. Der Betrieb dieser Server und die Aufrechterhaltung der Kühlung ist eine der Hauptursachen für den Stromverbrauch.

Diese Lasten zeichnen sich durch einen hohen Energieverbrauch, schwankende Betriebsanforderungen und einen hohen Kühlungsbedarf aus. Die interne Konfiguration der Last, einschließlich Reservestrom und internem Schutz, kann äußerst kompliziert sein. Da Rechenzentren und andere Rechenlasten häufig an Orten mit erschwinglicher und zuverlässiger Stromversorgung zu finden sind, sind rigorose Netzplanung und Anschlusstechniken erforderlich. Da große Lasten die zukünftigen Energiesysteme zunehmend dominieren werden, besteht die größte Herausforderung darin, diese Schwierigkeiten proaktiv anzugehen, um die Dynamik des Netzes besser zu verstehen.

Ebenso wichtig ist, dass es der Branche immer noch an klaren Vorschriften und standardisierten Methoden für die Modellierung und Integration solch komplexer Lasten mangelt, was den Datenzugriff und die Konsistenz zu einer wachsenden Herausforderung für Planer und Forscher:innen gleichermaßen macht.

Bei Rechenzentren besteht die Herausforderung darin, dass mehrere Komponenten auf sehr unterschiedlichen Zeitskalen interagieren: Schutzsysteme, Leistungselektronik, Steuerungen und das Energiemanagementsystem (EMS), zumal die meisten Rechenzentren auf Backup-Quellen wie USV-Einheiten oder Generatoren angewiesen sind. Schnelle Schaltvorgänge in Umrichtern erfolgen in Mikrosekunden, während Schutzsysteme und Ride-Through-Verhalten in Millisekunden beobachtet werden.

Das Tests der Wechselwirkungen zwischen all diesen Systemen ist von entscheidender Bedeutung, nicht nur für die Validierung aktueller Entwürfe, sondern auch für die Erforschung neuer Steuerungsansätze und -technologien, die unterstützen Auswirkungen auf das Stromnetz abmildern könnten, wie E-STATCOM, Peak Shaving oder Blindleistungskompensation. Die Hardware(HIL)-Simulation ermöglicht es, beide Enden dieses Spektrums zu testen. FPGA-basierte Tools erfassen die ultraschnellen Oberschwingungen von Gleichrichtern, Wechselrichtern und Festkörpertransformatoren, während CPU-basierte Solver langsamere, aber ebenso kritische Verhaltensweisen wie Spannungsstabilität und Fehlerüberbrückung behandeln. Durch diese Kombination können Sie überprüfen, wie die internen Systeme eines Rechenzentrums mit dem größeren Netz interagieren, um sicherzustellen, dass Kühlung, Notstromversorgung und komplexe elektronische Lasten auch unter Belastung stabil bleiben.

Da die Rechenzentren immer größer und komplexer werden, können ihre Auswirkungen auf die globalen Energiesysteme nicht ignoriert werden. Die Kombination aus massivem Strombedarf, schwankenden Lasten und erheblichem Kühlungsbedarf unterstreicht den dringenden Bedarf an intelligenter Netzplanung und innovativen technischen Lösungen. Durch den Einsatz von Echtzeitsimulationen, fortschrittlicher Modellierung und effizienterem Infrastrukturdesign kann die Branche sicherstellen, dass Rechenzentren zuverlässige, nachhaltige und widerstandsfähige Eckpfeiler der digitalen Wirtschaft bleiben.