7 façons dont la simulation s'effondre dans les essais de véhicules autonomes et comment y remédier

Automobile

08 / 06 / 2025

Chaque prototype bloqué est perçu comme une occasion manquée lorsque l'on court pour rendre latechnologie de conduite autonome sûre. Les étapes du programme s'éloignent, la confiance des bailleurs de fonds vacille et les ingénieurs se démènent pour expliquer pourquoi le banc d'essai refuse de suivre le rythme des itérations de conception. Vous ressentez la pression des responsables qui veulent avoir la preuve que les algorithmes de perception ne classeront pas mal un piéton une fois que la voiture aura quitté le terrain d'essai. À ce moment-là, la qualité de la simulation et l'orchestration des tests décident si votre prochain rapport mettra en évidence les progrès ou les retards.

Les calendriers se resserrent, mais la complexité des ensembles de capteurs des véhicules d'aujourd'hui ne cesse de croître, rassemblant radar, lidar, caméras et calcul haute performance dans un pipeline fragile. Un problème inattendu au sein de ce pipeline peut transformer un cycle de régression d'une semaine en un exercice d'évacuation de trois semaines. Les équipes qui maîtrisent cette complexité obtiennent des approbations plus rapides, regagnent de la marge budgétaire et renforcent leur crédibilité auprès des partenaires réglementaires. Les autres continuent d'ajouter des correctifs jusqu'à ce que leur matrice de test devienne ingérable.

La qualité de la simulation et l'orchestration des tests déterminent si votre prochain rapport mettra en évidence les progrès ou les retards.

Causes courantes des retards dans la validation des véhicules autonomes

Les piles de fusion de capteurs, les flux de travail de sécurité fonctionnelle et les vérifications de cybersécurité tirent tous sur la même réserve limitée de matériel en boucle (HIL). Cet encombrement crée des frictions de calendrier qui se répercutent en cascade sur des retards de programme plus importants, exposant les défis des essais et de la validation des véhicules autonomes qui tourmentent de nombreuses équipes d'ingénieurs. Chaque fois qu'un système testé attend le banc, les ingénieurs risquent de perdre le contexte, ce qui entraîne un nouveau travail et un double triage des bogues. Même lorsque le banc est disponible, la reconfiguration manuelle fait souvent perdre une demi-journée avant qu'un seul scénario puisse être exécuté.

La dynamique des essais s'essouffle encore plus lorsque la fidélité du modèle est en retard par rapport aux modifications de la conception. L'émulation de capteurs à faible résolution masque les défauts jusqu'aux essais sur piste, ce qui entraîne des retouches coûteuses. Les transferts de fichiers entre les outils de conception de bureau et le stockage HIL peuvent prendre des heures, ce qui rend impossible les essais de régression du jour au lendemain. Si l'on ajoute les exigences de gouvernance en matière de traçabilité pour des milliers de scénarios, la file d'attente devient plus longue que le sprint lui-même.

7 défis de simulation courants dans les projets de conduite autonome

Une validation précise et opportune sépare les voitures conceptuelles des flottes de production. Les ingénieurs sont soumis à une pression croissante de la part des autorités chargées de la sécurité, des investisseurs et de l'opinion publique, qui exigent tous des preuves crédibles que les fonctions d'autonomie fonctionnent dans un trafic complexe. La simulation promet un kilométrage quasi infini sans prototypes physiques, mais son efficacité s'effondre lorsque les canalisations, les modèles ou la gestion des données ne sont plus alignés. Un examen plus approfondi de ces fractures révèle les obstacles les plus tenaces et la manière dont des flux de travail disciplinés les éliminent efficacement.

1. Les modèles incomplets ou de faible fidélité réduisent la couverture des tests

Les modèles de perception à un stade précoce reposent souvent sur une cinématique simplifiée ou sur des profils d'erreur génériques des capteurs. Ces raccourcis semblent acceptables jusqu'à ce que des accidents surviennent lors d'essais sur circuit fermé, obligeant à des réparations d'urgence qui détournent l'attention des travaux prévus sur les fonctionnalités. Les maillages de terrain à haute résolution, les coupes transversales détaillées des radars et les couches de bruit dépendant des conditions météorologiques permettent d'exposer les failles silencieuses avant le début des essais sur piste. Le maintien de cette fidélité entre plusieurs fournisseurs s'avère toutefois difficile lorsque les formats de fichiers et les pratiques de mise à jour divergent.

Les ensembles de données de simulation vieillissent rapidement à mesure que les paramètres de conception changent, ce qui entraîne des mesures de confiance trompeuses. Les équipes qui adoptent des pipelines de validation de modèles automatisés détectent les actifs périmés avant que les constructions nocturnes ne commencent, préservant ainsi la confiance dans les indicateurs de performance clés. Des limites de propriété claires et des spécifications d'interface modulaires réduisent les frictions entre les contributeurs du système de systèmes. L'investissement dans un stockage évolutif avec des étiquettes de métadonnées robustes permet de réduire le temps de récupération sans compromettre la granularité.

2. Les problèmes d'intégration de la chaîne d'outils provoquent l'instabilité des tests

Les scripts qui relient les moteurs physiques à source fermée, les logiciels intermédiaires personnalisés et les moniteurs de sécurité cachent souvent des pics de latence subtils. Ces pics introduisent un comportement non déterministe dans les cycles en boucle fermée, érodant la confiance dans la logique de contrôle dépendant du temps. Les ingénieurs perdent de précieuses journées à isoler un obscur dépassement de mémoire tampon plutôt qu'à collecter des données de couverture. Une stratégie d'intégration disciplinée, ancrée par des interfaces de programmation d'applications (API) ouvertes et le linting du code, empêche ces perturbations de se propager à travers les sprints.

En cas de décalage de version, des procédures déterministes de retour en arrière permettent de rétablir une base de référence connue en quelques minutes au lieu de quelques heures. Les serveurs d'intégration continue qui compilent, déploient et testent chaque version de code détectent les conflits de dépendance avant le début d'une campagne formelle. Les schémas de journalisation partagés simplifient le triage en alignant les horodatages et les identifiants de capteurs dans les sous-systèmes. Le résultat net est un flux de test reproductible et traçable qui satisfait à la fois les audits internes et les organismes de certification externes.

3. La génération de scénarios manque de diversité

Les bibliothèques de scénarios sont souvent orientées vers des conditions de conduite confortables parce que les collecteurs de données garent les véhicules lorsque les conditions météorologiques se détériorent. L'absence de brouillard, de poudrerie ou de signalisation de chantier atypique fait que les algorithmes de perception sont dangereusement sous-entraînés. Les générateurs de scénarios synthétiques promettent la variété, mais la randomisation naïve ne tient pas compte des juxtapositions critiques pour la sécurité, telles que les virages à gauche non protégés sur des pentes en crête. Les ingénieurs renforcent la diversité en appliquant une pondération basée sur le risque, qui s'appuie sur les bases de données de sinistres et d'incidents.

Une fois les conditions de priorité définies, des modèles paramétrés modifient systématiquement la vitesse, le positionnement et la densité du trafic, multipliant ainsi la couverture sans augmenter la capacité de stockage. Des barrières d'évaluation humaine signalent les scènes visuellement invraisemblables qui, autrement, consommeraient inutilement des cycles de simulation. Au fil du temps, les tableaux de bord analytiques mettent en évidence les groupes de scénarios présentant des taux d'échec élevés et persistants, ce qui permet d'apporter des améliorations ciblées plutôt que de procéder à des réglages dispersés. Cette boucle de rétroaction permet aux bibliothèques de scénarios de rester légères et puissantes.

4. L'évolutivité limitée du matériel dans la boucle ralentit l'itération

Un seul rack HIL peut coûter des centaines de milliers de dollars, ce qui incite les responsables budgétaires à limiter les déploiements. Au fur et à mesure que les équipes de développement se multiplient, la concurrence pour le temps de travail augmente de manière directement proportionnelle au carnet de commandes. La mise en file d'attente à distance est utile, mais les pénalités de latence et les problèmes de sécurité limitent les gains de débit. Les instances HIL virtuelles exécutées sur des ressources FPGA ( field-programmable gate array ) en nuage offrent de l'élasticité, mais les retouches des tests d'intégration freinent souvent l'adoption.

Les programmes réussis répartissent les charges de travail entre les boucles de contrôle déterministes de bas niveau qui doivent être exécutées sur des cartes FPGA physiques et les charges de travail de perception à plus grande latence qui peuvent migrer vers des ordinateurs virtualisés. Les règles d'allocation codifiées dans les scripts d'orchestration maintiennent les délais en temps réel tout en maximisant la concurrence. Les ingénieurs créent ensuite des répliques de courte durée dans le nuage pour les tests de régression, libérant ainsi les plates-formes sur site pour l'approbation finale à fort enjeu. Les tableaux de bord de suivi des coûts liés aux codes de compte permettent aux équipes financières d'être à l'aise avec l'utilisation du paiement à l'utilisation.

5. La simulation en temps réel ne suffit pas dans des conditions complexes

Les essais d'autonomie imposent de lourdes charges de calcul en raison de la densité des maillages de capteurs, de la dynamique des véhicules basée sur la physique et des modèles météorologiques d'ordre élevé. Lorsque les temps de trame dépassent les tolérances de l'ordre de la milliseconde, les boucles de contrôle se déstabilisent, produisant des faux négatifs qui gaspillent les cycles de débogage. L'accélération des FPGA atténue ce risque, mais le partitionnement des instructions sur des unités de traitement hétérogènes exige des compétences spécialisées. Les ingénieurs accélèrent l'intégration en adoptant des conceptions de référence qui associent automatiquement les noyaux de calcul au silicium approprié.

Les outils de profilage des performances intégrés dans la pile de simulation signalent les points chauds bien avant qu'ils ne menacent les engagements pris dans le calendrier. Des algorithmes adaptatifs de niveau de détail (LOD) réduisent la taille des décors périphériques tout en préservant la précision du premier plan. Des campagnes régulières de tests de stress enregistrent les tailles de matrice les plus défavorables et propagent ces mesures dans les tableaux de bord de planification des ressources. Ces pratiques permettent de maintenir des temps de rafraîchissement stables, ce qui favorise l'intégration continue de nouveaux modèles de capteurs et de mises à jour d'algorithmes.

6. Les défis liés à la gestion des données affectent la traçabilité et la répétabilité

Des pétaoctets de nuages de points lidar, de cartes haute définition et de journaux de télémétrie submergent les structures de dossiers ad hoc. Lorsque les conventions de dénomination dérivent, les ingénieurs ont du mal à retracer une régression jusqu'à la définition du scénario d'origine. Les exigences d'audit pour les certifications de sécurité fonctionnelle amplifient la douleur, car chaque ensemble de données doit correspondre à des exigences spécifiques et à des critères de réussite ou d'échec. L'adoption de magasins d'objets contrôlés par version avec des identifiants d'enregistrement immuables permet d'éviter les écrasements silencieux qui font dérailler les examens de conformité.

Des pétaoctets de nuages de points lidar, de cartes haute définition et de journaux de télémétrie submergent les structures de dossiers ad hoc.

La collecte automatique des métadonnées étiquette chaque artefact de simulation avec des hachages de paramètres, des identifiants de validation de logiciel et des références de nomenclature matérielle. Les moteurs d'interrogation basés sur ces étiquettes renvoient les chaînes de provenance en quelques secondes, ce qui facilite l'analyse des causes profondes et les enquêtes sur les rappels. Les contrôles d'accès basés sur les rôles protègent les données sensibles tout en permettant une collaboration transparente entre des équipes dispersées dans le monde entier. Ensemble, ces pratiques favorisent la confiance dans le fait que chaque mesure du tableau de bord reflète les conditions d'entrée correctes.

7. Installation et reconfiguration fastidieuses des bancs d'essai

Les harnais de capteurs câblés à la main, les cycles d'alimentation manuels et les étapes de configuration basées sur des feuilles de calcul obligent les ingénieurs à rester inactifs entre les séries. Une simple erreur de positionnement d'un connecteur peut anéantir un lot d'une nuit, consommant ainsi une précieuse journée de travail pour les répétitions. L'automatisation de l'orchestration du banc par le biais d'une configuration scénarisée des dispositifs et de l'alignement des jumeaux numériques transforme des heures de bricolage en minutes de routine reproductible. La conception modulaire des fixations réduit encore le travail physique en permettant aux équipes d'échanger les piles de perceptions sans perturber les sous-systèmes de dynamique du véhicule.

Les référentiels de configuration en tant que code capturent chaque paramètre de configuration, des tables de biais des capteurs aux versions de flux binaire du FPGA. Les cadres de déploiement continu transmettent ces configurations aux contrôleurs HIL, en validant l'intégrité des sommes de contrôle avant le début de l'exécution. Lorsqu'une nouvelle révision du matériel arrive, les ingénieurs mettent à jour un manifeste YAML plutôt que d'éditer plusieurs feuilles de calcul, préservant ainsi les connaissances institutionnelles dans le cadre du contrôle de version. Les délais de mise en service prévisibles permettent de s'assurer que chaque sprint se termine par des résultats validés plutôt que par des doutes persistants.

Les gains techniques obtenus grâce à la résolution de ces problèmes deconduite autonome dépassent largement le cadre du laboratoire. Des cycles de régression plus courts permettent aux équipes de se concentrer sur l'innovation des fonctionnalités plutôt que sur la lutte contre les incendies. Une meilleure traçabilité consolide les dossiers de sécurité lors des soumissions réglementaires, ce qui accélère la mise sur le marché et renforce la réputation de la marque. La prévisibilité des coûts améliore la planification du capital, soutenant les décisions stratégiques concernant l'investissement dans les plateforme et la dotation en personnel.

Comment les véhicules autonomes sont-ils testés à l'aide d'outils de simulation en temps réel ?

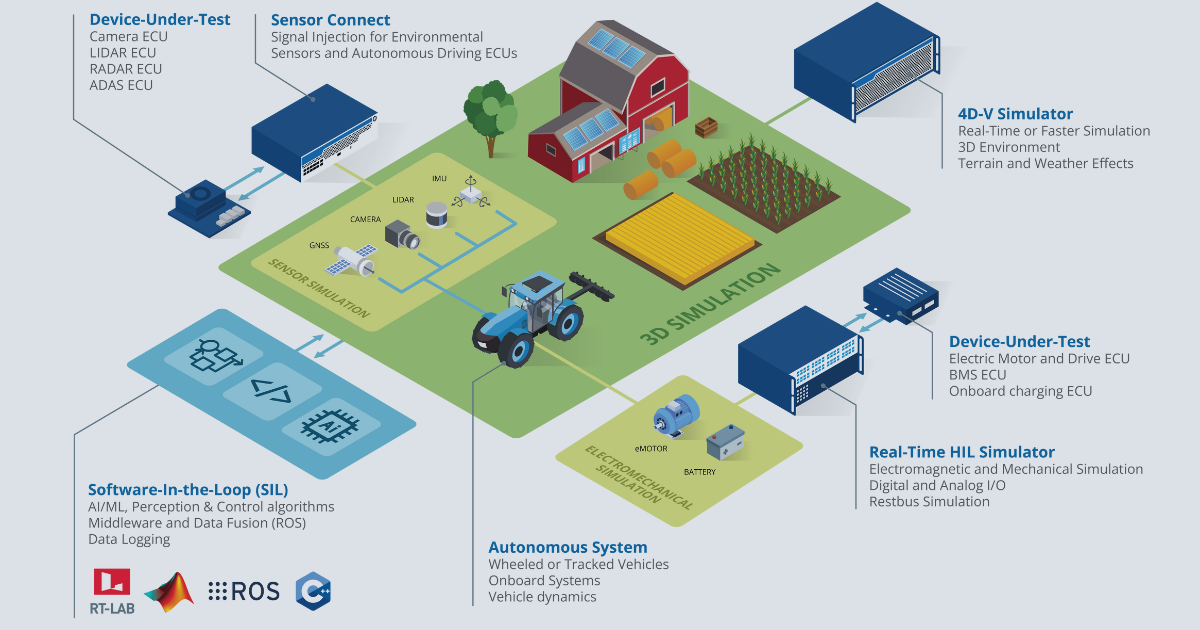

Les équipes de projet commencent la conception du banc en sélectionnant des moteurs d'exécution déterministes capables de synchroniser la physique, l'émulation des capteurs et le logiciel de contrôle en respectant des contraintes de temps strictes. Les plates-formes matérielles dans la boucle accueillent les unités de contrôle électronique (ECU) et les accélérateurs de perception, tandis que les réseaux de portes programmables sur le terrain imposent des délais inférieurs à la milliseconde. Les praticiens qui se demandent comment les véhicules autonomes sont testés reconnaissent rapidement que les interfaces ouvertes sont aussi importantes que la puissance de traitement brute, car les outils de conception basés sur des modèles doivent transférer les artefacts sans perte de données. Les paquets standardisés d'interface de maquette fonctionnelle (FMI) et les ponts du système d'exploitation de robot (ROS 2) maintiennent ce transfert propre, permettant à des sous-systèmes hétérogènes de partager des horodatages de simulation.

Pendant l'exécution, les serveurs de scénarios transmettent au cœur de la simulation des réseaux routiers numériques, des agents de circulation et des paramètres météorologiques. Les données synthétiques des capteurs passent par des pilotes de bas niveau jusqu'au micrologiciel de l'ECU, en exerçant la même pile que celle destinée à la production en série. L'enregistrement à grande vitesse capture les signaux bruts et les décisions des algorithmes, alimentant des tableaux de bord analytiques qui comparent les résultats aux principaux indicateurs de sécurité. Les ingénieurs affinent alors les seuils de perception, les gains de contrôle ou la logique de traitement des défaillances et rejouent des scénarios identiques en quelques minutes, verrouillant les corrections avant que les budgets des prototypes physiques n'explosent.

Comment OPAL-RT aide à résoudre les problèmes de test et de validation des véhicules autonomes

OPAL-RT propose des plates-formes de simulation en temps réel de haute précision et à faible latence aux ingénieurs qui refusent de faire des compromis sur la précision de la synchronisation ou l'architecture ouverte. Notre matériel modulaire s'adapte aux charges de travail centrées sur le CPU et le FPGA, ce qui vous permet d'adapter les ressources de calcul à chaque sous-système sans gaspiller d'espace de rack ou de capital. La suite logicielle RT-LAB aligne les ressources MATLAB / Simulink, FMI/FMU et Python au sein d'un noyau d'ordonnancement unique, ce qui vous permet de passer des modèles entre la conception de bureau et l'exécution matérielle dans la boucle sans gymnastique de format. Les outils de surveillance intégrés signalent instantanément les dépassements de délais, ce qui permet à votre équipe d'avoir une vision claire des goulets d'étranglement avant qu'ils ne menacent les objectifs de sécurité. Les licences restent flexibles, ce qui permet aux chefs de projet d'aligner les dépenses sur les objectifs du sprint plutôt que de s'engager à acheter une capacité fixe.

Au-delà des performances, les plateformes OPAL-RT apportent la tranquillité d'esprit aux programmes de test et de validation des véhicules autonomes. Les identifiants de scénario immuables, la capture automatique des métadonnées et les contrôles d'accès basés sur les rôles satisfont aux audits rigoureux de sécurité fonctionnelle. La prise en charge native de l'exécution en nuage (cloud-burst) étend la capacité HIL pendant les phases de régression, tandis que les bancs locaux se concentrent sur les essais de validation finale. Le personnel de soutien mondial comprend d'anciens ingénieurs en simulation qui vous rencontrent en laboratoire ou en ligne, ce qui raccourcit les cycles de diagnostic et préserve l'élan. Vous pouvez faire confiance à OPAL-RT pour garantir la précision, la discipline budgétaire et la confiance dans le calendrier à chaque phase du développement de l'autonomie.

Questions courantes

Quels sont les principaux goulets d'étranglement dans les processus d'essai des véhicules autonomes ?

L'instabilité des tests, les lacunes dans la génération de scénarios et le traitement des données ralentissent les cycles de validation. Les équipes sont souvent confrontées à des modèles incomplets, à la lenteur de la configuration HIL et à l'absence de couverture des cas limites. Ces problèmes allongent les délais de développement et réduisent la confiance dans l'état de préparation du logiciel. Pour les résoudre, il faut des outils de simulation haute fidélité, des cadres d'intégration ouverts et une infrastructure évolutive. OPAL-RT fournit des plateformes de simulation en temps réel qui contribuent à éliminer ces obstacles et à accélérer la validation avec précision.

Comment améliorer la couverture des tests pour les cas limites dans les projets de conduite autonome ?

L'élargissement de la couverture des tests signifie qu'il faut aller au-delà des scénarios de circulation courants pour inclure des situations à haut risque et à faible fréquence, comme les zones de construction, les intempéries ou l'interférence des capteurs. Les équipes peuvent augmenter la variation en utilisant des modèles paramétrés et une pondération basée sur le risque et sur des données d'incidents réels. La diversité des scénarios est essentielle pour construire des systèmes de perception et de contrôle robustes. OPAL-RT prend en charge l'émulation haute fidélité avec des outils d'injection de scénarios personnalisables pour renforcer votre couverture avec un contrôle mesurable.

Pourquoi les tests en boucle du matériel ralentissent-ils lors de la mise à l'échelle ?

La capacité de test HIL se heurte souvent à un mur lorsque les équipes partagent un nombre limité de bancs d'essai entre plusieurs projets. En l'absence d'infrastructure évolutive ou d'options virtuelles, les retards de test sont inévitables. Les déploiements basés sur le cloud et la répartition des charges de travail entre les ressources physiques et virtuelles sont essentiels. OPAL-RT offre des options de déploiement flexibles qui permettent d'augmenter le débit sans compromettre les contraintes de temps réel, ce qui vous permet d'évoluer sans sacrifier la qualité.

Comment puis-je assurer la répétabilité et la traçabilité de mes simulations ?

La gestion de téraoctets de données de capteurs et de résultats de tests devient difficile sans une stratégie de données structurée. Des artefacts versionnés, l'étiquetage des métadonnées et des pratiques de configuration en tant que code sont nécessaires pour relier chaque test à ses paramètres. Cette clarté favorise l'auditabilité et l'assurance qualité interne. La plateforme OPAL-RT capture la provenance complète des données et les métadonnées des scénarios pour aider les équipes à répondre aux normes de certification tout en conservant leur agilité opérationnelle.

Comment les outils de simulation sont-ils utilisés pour valider les véhicules autonomes ?

Les outils de simulation en temps réel reproduisent les capteurs, les réseaux routiers et la dynamique des systèmes pour tester les systèmes de véhicules autonomes dans des conditions contrôlées. Ces outils doivent interagir avec le matériel de contrôle réel et refléter les charges de travail de production afin de fournir un retour d'information précis sur les performances. Le réalisme, la précision des temps et l'ouverture à des modèles tiers sont essentiels. OPAL-RT offre ces trois caractéristiques grâce à ses simulateurs hybrides FPGA/CPU, ce qui vous permet d'itérer plus rapidement et de valider en toute sécurité.

EXata CPS a été spécialement conçu pour des performances en temps réel afin de permettre des études de cyberattaques sur les réseaux électriques à travers la couche du réseau de communication de n'importe quelle taille et se connectant à n'importe quel nombre d'équipements pour des simulations HIL et PHIL. Il s'agit d'une boîte à outils de simulation à événements discrets qui prend en compte toutes les propriétés physiques inhérentes qui affecteront le comportement du réseau (câblé ou sans fil).