Manuel de simulation pour les véhicules autonomes à l'usage des ingénieurs confirmés

Systèmes d'alimentation

08 / 05 / 2025

Chaque kilomètre parcouru par un prototype de conduite autonome in silico vous épargne des heures coûteuses sur un terrain d'essai, réduit l'exposition aux retombées juridiques et accélère le passage du concept à la flotte commerciale. Vous connaissez la pression : fournir des piles de perception, de planification et de contrôle qui se comportent de manière irréprochable alors que les régulateurs, les dirigeants et le public s'attendent à une performance zéro incident. La simulation répond à cette pression par une couverture exhaustive et déterministe que les tests physiques ne pourront jamais égaler. Les équipes qui s'emparent aujourd'hui des essais numériques haute fidélité établissent la référence en matière de sécurité sur laquelle le secteur s'appuiera demain.

Les cycles d'homologation stricts et les contrôles budgétaires n'attendent personne, mais la complexité des systèmes autonomes ne cesse de croître. L'augmentation du nombre de capteurs, le traitement hétérogène et les mises à jour en temps réel signifient que vous devez faire face à une cible mouvante juste pour maintenir votre plan de validation stable. La simulation, lorsqu'elle est utilisée avec rigueur, réduit ces éléments mobiles en tâches reproductibles et traçables, ce qui vous donne la confiance nécessaire pour publier des logiciels rapidement et effectuer des mises à jour fréquentes. La précision en temps réel et les méthodes HIL (hardware-in-the-loop) sont désormais des enjeux de taille pour tout ingénieur chevronné qui veille à la fois à sa réputation et à ses calendriers de mise sur le marché.

Chaque kilomètre parcouru par un prototype de conduite autonome in silico vous épargne des heures coûteuses sur un terrain d'essai, réduit l'exposition aux retombées juridiques et accélère le passage du concept à la flotte commerciale.

Pourquoi la simulation de véhicules autonomes est-elle essentielle pour la validation et la sécurité ?

La simulation de véhicules autonomes protège les vies et les budgets en vous permettant de sonder des milliers de kilomètres de cas limites avant qu'une seule roue ne tourne sur l'asphalte. Les jumeaux numériques reproduisent le trafic, les conditions météorologiques et les injections de défauts avec une répétabilité déterministe, ce qui vous permet d'isoler les défauts de perception subtils bien avant qu'ils ne se transforment en défaillances de type rappel. La simulation continue accélère également la conformité aux normes, car chaque exigence, de la sécurité fonctionnelle à la cybersécurité, peut être vérifiée dans des conditions contrôlées de latence et de perte de paquets. Le résultat final est un chemin plus court vers le marché, soutenu par une preuve quantitative que votre logique de perception, de planification et de contrôle résistera aux surprises les plus dures de la route.

Un deuxième avantage est la traçabilité transparente. Lorsque les auditeurs ou les assureurs demandent une preuve de diligence raisonnable, les journaux de simulation associent chaque exigence à des artefacts de test concrets, horodatés et immuables. Cette traçabilité protège les décisions d'ingénierie et facilite l'analyse des causes profondes en cas d'incident sur le terrain. Enfin, la simulation favorise l'itération collaborative, en permettant aux experts en perception, aux ingénieurs de contrôle et aux équipes de sécurité de partager la même capture d'un incident, puis de la rejouer avec des paramètres modifiés. Votre organisation bénéficie d'un langage et d'un calendrier communs pour la réduction itérative des risques.

En quoi les essais de véhicules autonomes diffèrent-ils des essais automobiles traditionnels ?

Les ingénieurs de validation qui passent des projets de groupes motopropulseurs conventionnels aux programmes autonomes remarquent rapidement des courbes d'apprentissage plus marquées. Les cycles traditionnels d'endurance et d'émissions se concentrent sur des charges prévisibles, alors que les fonctions de conduite autonome s'attaquent au trafic stochastique, aux interférences des capteurs et aux dérives de l'apprentissage automatique. Les cycles de travail bien définis sont remplacés par des demandes de couverture de scénarios probabilistes. Les cas de sécurité dépendent donc de l'approbation statistique plutôt que de seuils de fatigue discrets.

Complexité des capteurs

Les cadres de fusion de capteurs doivent gérer les décalages de latence sans perte de trame, sinon la perception sera perturbée juste au moment où un piéton apparaîtra. La dérive de l'horloge entre les dispositifs ne peut pas être masquée par des tentatives, car le monde ne s'arrête jamais ; c'est pourquoi les ingénieurs utilisent des protocoles de temps de précision et un réseau Ethernet déterministe pour limiter la gigue à des tolérances de l'ordre de la microseconde. La simulation permet de balayer les décalages temporels sur des profils de température réalistes afin de mettre en évidence des désalignements rares mais catastrophiques. De vastes bibliothèques de capteurs virtuels permettent de réduire de plusieurs semaines la mise au point des bancs d'essai et d'affiner plus tôt les algorithmes de fusion.

Les appareils en boucle alimentent l'ordinateur du véhicule en nuages de points lidar bruts, ce qui permet de vérifier le micrologiciel de décodage sans attendre les mises à jour du matériel du fournisseur. Les modèles de capteurs paramétrés échangent les résolutions et les champs de vision en quelques minutes, ce qui aide les architectes à comparer les compromis en matière de nomenclature. Cette approche permet également d'éviter les délais douaniers lorsque les prototypes de capteurs franchissent les frontières. Votre équipe maintient un rythme d'itération élevé, en renforçant la résilience des pipelines de perception bien avant l'arrivée des prototypes.

Prolifération des cas extrêmes

Les cycles de durabilité classiques peuvent nécessiter des centaines d'heures, mais les piles autonomes doivent survivre à des millions de scénarios synthétiques allant de l'éblouissement dû à un faible ensoleillement au trafic erratique de la micro-mobilité. Les fonctions de densité de probabilité guident la génération de scénarios aléatoires, mais une véritable couverture exige des cas particuliers ciblés qui mettent à l'épreuve les limites de décision de l'apprentissage automatique. Les orchestrateurs de simulation classent l'importance des scénarios en fonction de la contribution au risque, en orientant les suites de régression nocturnes vers les permutations de plus grande valeur. Ce processus transforme l'échantillonnage statistique brut en une exploration disciplinée et axée sur la sécurité.

Les programmes autonomes s'appuient souvent sur des fermes basées sur le cloud qui parallélisent les balayages de scénarios et renvoient des mesures de réussite et d'échec lors des réunions matinales. Les ingénieurs trient alors les comportements erronés en toute fidélité, les retours des capteurs et les étiquettes de vérité au sol étant conservés pour l'analyse post-mortem. Ce flux de travail raccourcit les boucles de triage car les défaillances apparaissent dans leur contexte, et non comme des codes de réussite abstraits. Les preuves centrées sur les données s'intègrent directement dans la documentation du dossier de sécurité.

Fonctionnalité définie par logiciel

Les mises à jour permanentes permettent aux équipes chargées des fonctionnalités de proposer de nouveaux algorithmes de contrôle plusieurs fois par trimestre, ce qui oblige les cadres de validation à s'éloigner de la validation d'une version unique. La simulation devient un pont d'intégration continue, plaçant les versions candidates en boucle avec les modèles de capteurs et de dynamique du véhicule quelques minutes après la fusion du code. Toute régression déclenche le dépôt automatisé d'un rapport de bogue, ce qui permet d'éviter les cascades de défauts cumulés. Cette pratique permet d'aligner le développement autonome sur les principes agiles sans compromettre la discipline de sécurité.

La gestion de la configuration lie chaque artefact de simulation à une version spécifique, ce qui permet d'éviter les audits réglementaires, même si les branches explosent. Vous obtenez un lien vérifiable entre les lignes de code et les kilomètres de données de conduite synthétiques. Ce lien évite les arguments du type "ça a marché sur mon ordinateur" lorsque les incidents sont examinés par le comité de révision. La confiance augmente au fur et à mesure que les débats subjectifs font place à des statistiques de couverture objectives.

Examen réglementaire

Des organismes tels que Transports Canada et la National Highway Traffic Safety Administration (NHTSA) des États-Unis exigent la preuve que les fonctions de conduite autonome respectent les normes de sécurité fonctionnelle et de cybersécurité dans des conditions de circulation imprévisibles. La simulation permet de satisfaire à ces normes car il est possible d'injecter des données de navigation mondiale usurpées, des attaques de la couche réseau et des défaillances de capteurs sans mettre en danger les participants. Des ensembles de preuves détaillés associent chaque exigence à des ensembles de scénarios, conformément aux normes ISO 26262 et ISO/SAE 21434. Les ingénieurs extraient rapidement les mesures de couverture, ce qui accélère les dossiers de conformité.

Les réglementations diffèrent d'une juridiction à l'autre, mais les plates-formes de test virtuelles résument ces différences dans des fichiers de paramètres de scénario. Plutôt que de reconstruire des bancs d'essai pour chaque marché, vous ajustez les règles et la densité du trafic, puis vous relancez la même campagne. Les données issues de ces répétitions témoignent de l'attention portée aux autorités locales. Les équipes évitent les cycles de certification prolongés, ce qui permet de commercialiser les produits plus rapidement tout en préservant la confiance du public.

Les essais de véhicules autonomes sont plus complexes que les programmes automobiles classiques car ils traitent la probabilité, la perception et la connectivité comme des citoyens de première classe. Une seule erreur de synchronisation peut se traduire par une décision de contrôle catastrophique, de sorte que la couverture des tests doit s'étendre à la fois horizontalement à travers les scénarios et verticalement à travers les couches logicielles et matérielles. La simulation fournit le seul cadre pratique capable de maintenir cette échelle avec rigueur. Les ingénieurs principaux qui maîtrisent ces distinctions réalisent des projets d'autonomie plus sûrs et plus fiables tout en protégeant les intérêts des entreprises et du public.

Comment la simulation pour les véhicules autonomes améliore la rapidité et la rentabilité

Les chefs de projet mesurent le succès à la fois en termes de rapidité des sprints et de restrictions budgétaires, et la simulation a une incidence directe sur chacun de ces paramètres. Les réservations traditionnelles de terrains d'essai et la construction de prototypes sur mesure grèvent les budgets plus rapidement que ne le prévoient les feuilles de calcul. Les jumeaux numériques, une fois établis, réduisent ces dépenses tout en comprimant les cycles d'itération. Vous récupérez des heures d'ingénierie et du capital pour l'innovation stratégique.

- L'exécution en parallèle multiplie la couverture. Les clusters en nuage exécutent des milliers de scénarios simultanément, ce qui permet d'obtenir des mesures exploitables du jour au lendemain, au lieu de plusieurs mois de tests de suivi.

- La détection précoce des bogues permet de réduire les coûts de réoutillage. La détection des défauts de fusion des capteurs avant le gel du matériel permet d'éviter les retouches tardives de la carte et les correctifs urgents du micrologiciel.

- Les modèles réutilisables réduisent les délais d'approvisionnement. Les modèles paramétrés de véhicules et de capteurs vous permettent de tester des variantes de configuration sans avoir à commander de nouvelles pièces ou à attendre les fournisseurs.

- La régression automatisée réduit le travail manuel. Les pipelines d'intégration continue déclenchent automatiquement des balayages de simulation, ce qui permet aux ingénieurs de se concentrer sur le diagnostic plutôt que sur l'exécution répétitive.

- La conception basée sur des scénarios permet de raccourcir les files d'attente pour la certification. Les paquets de preuves générés pendant les tests virtuels s'alignent parfaitement sur les formulaires d'approbation gouvernementaux, ce qui accélère la signature et réduit les frais juridiques.

- Les licences évolutives évitent les paiements excessifs. La facturation à l'utilisation permet d'augmenter la capacité de test uniquement lorsque la file d'attente s'allonge, ce qui évite les dépenses d'investissement fixes pour du matériel sous-utilisé.

Les campagnes numériques offrent des retours mesurables dès le premier sprint car elles remplacent les prototypes coûteux par des substituts mathématiquement exacts. L'exécution de plus de tests en moins de temps renforce les marges de sécurité tout en protégeant les budgets. Les équipes financières voient moins de surprises et les chefs de file ingénierie présentent des progrès visibles chaque semaine. Cette approche fait de la simulation des véhicules autonomes un facteur de différenciation stratégique plutôt qu'une simple tâche de validation.

Les étapes clés d'une simulation autonome typique que les ingénieurs doivent connaître

Un flux de travail structuré permet aux équipes interfonctionnelles de rester en phase avec la complexité croissante des logiciels. À chaque étape, des artefacts précis sont transmis, ce qui impose des interfaces propres et des tests reproductibles. Le processus favorise également la réduction progressive des risques, car les défaillances apparaissent dès que possible. La compréhension de ces étapes permet d'ancrer votre programme dans des étapes prévisibles et vérifiables.

Planification du modèle dans la boucle

Les ingénieurs concepteurs élaborent des modèles comportementaux de haut niveau pour prouver la logique de planification des trajets avant de toucher au matériel en temps réel. Les représentations abstraites de la dynamique du véhicule, du trafic et de la latence des capteurs révèlent rapidement les faiblesses algorithmiques. Sans un retour d'information opportun, les planificateurs risquent de s'enfermer dans des cas de figure irréalisables. Le modèle dans la boucle (MIL) vous permet d'ajuster les hypothèses dès le début, ce qui évite les changements en aval.

Vous pouvez injecter des perturbations dans le cycle d'entraînement, telles que de soudaines zones de faible friction ou des cyclistes errants, puis étudier la résilience de l'algorithme. Des mesures telles que l'erreur de suivi moyenne quadratique et l'utilisation du budget de calcul révèlent si les objectifs de performance restent intacts. La documentation générée ici permet d'étoffer le dossier de sécurité par la suite. Les équipes qui font l'impasse sur le MIL le paient souvent en retravaillant pendant les phases HIL.

Intégration du logiciel dans la boucle

Après avoir franchi les obstacles du MIL, les développeurs compilent le code de production et l'exécutent à l'intérieur de machines virtuelles soft-timed ou de conteneurs dockerisés. Le Software-in-the-loop (SIL) met en évidence les problèmes liés aux optimisations du compilateur, au threading et aux limites de la mémoire que les modèles abstraits dissimulent. L'intégration continue incorpore le SIL dans chaque livraison, ce qui permet d'obtenir des indicateurs de régression immédiats. Cette boucle de rétroaction étroite empêche la dette technique de s'accumuler.

L'enregistrement des données à ce stade préserve les traces de niveau variable pour un débogage approfondi. Lorsqu'un pointeur hors limites apparaît, vous pouvez croiser les journaux avec les résultats MIL pour identifier les causes profondes. L'union des rapports SIL et MIL permet de définir des critères d'acceptation précis pour les phases matérielles ultérieures. La discipline formelle permet ici d'accélérer la livraison globale sans sacrifier la créativité.

Profilage des performances du processeur dans la boucle

Le code qui réussit le SIL est transféré sur le microprocesseur cible ou le système sur puce attaché à un hôte déterministe. Le processeur en boucle (PIL) vérifie la synchronisation, la cohérence de la mémoire cache et la précision de la virgule flottante dans le cadre d'un véritable pipeline d'instructions. Les ingénieurs découvrent si les délais de la trame sont respectés en cas d'échec de l'antémémoire et d'erreurs de prédiction des branchements. Les délais manqués découverts maintenant permettent d'éviter des rappels coûteux plus tard.

PIL valide également les pragmas du compilateur et les accélérateurs matériels, tels que les unités de traitement graphique pour les réseaux neuronaux. Grâce à des sondes précises au niveau du cycle, vous identifiez où remanier ou décharger les tâches. Ces informations permettent d'éviter un surcadençage de dernière minute susceptible d'invalider les budgets thermiques. Les parties prenantes sont assurées que le matériel planifié répondra aux exigences de durée de vie.

Validation du matériel dans la boucle

Le matériel en boucle place l'unité de commande électronique complète, les capteurs ou les actionneurs en interaction en boucle fermée avec des modèles d'usine en temps réel. La latence doit rester en deçà des limites déterministes afin que l'unité se comporte comme si elle était sur la route. Cette étape valide l'intégrité électrique et temporelle, en vérifiant que les chiens de garde se déclenchent lorsque les capteurs se bloquent ou tombent en panne. Les ingénieurs peuvent déclencher l'affaissement de la tension, les erreurs de bus et les pannes de capteur en toute sécurité.

Les interfaces à grande largeur de bande, telles que l'Ethernet automobile, alimentent des flux lidar synthétiques à des débits binaires de production afin de confirmer la résilience du canal. Le réalisme accru permet de s'assurer que les mécanismes de retour en arrière des microprogrammes et les noyaux de sécurité réagissent comme prévu. Une fois que les unités ont survécu aux campagnes HIL exhaustives, les essais physiques sur route confirment la plupart du temps les paramètres plutôt que de révéler des surprises. Les gestionnaires de programme bénéficient d'une réduction substantielle des risques.

Régression des scénarios et analyse de la couverture

Au fur et à mesure que les versions s'accumulent, les suites de régression se multiplient. Les outils de gestion des scénarios associent des mesures à des identifiants d'exigences, ce qui permet de s'assurer que chaque nouvelle branche hérite des garanties antérieures. L'analyse de la couverture permet d'établir un tableau des exigences satisfaites et des risques résiduels. Les ingénieurs utilisent ces informations pour répartir judicieusement les heures de simulation.

Deuxième paragraphe : Les tableaux de bord affichant les cartes thermiques des risques aident les dirigeants à décider quand donner le feu vert aux déploiements pilotes. Les signaux quantitatifs l'emportent sur l'intuition, ce qui permet d'aligner les objectifs techniques et commerciaux. Lorsque les données révèlent des rendements décroissants, il est possible de réaffecter les ressources à de nouvelles fonctionnalités plutôt qu'à des tests redondants. Cette transparence est à la base de feuilles de route durables en matière d'autonomie.

Des tableaux de bord affichant des cartes thermiques des risques aident les dirigeants à décider quand donner le feu vert à des déploiements pilotes.

Le respect d'une séquence disciplinée, du MIL au HIL, renforce la confiance dans les résultats du code et du matériel. Chaque étape élimine une catégorie distincte de défauts, ce qui permet de les corriger à moindre coût. Des transferts structurés permettent d'éviter de pointer du doigt les responsables, car les portes de propriété et d'acceptation sont claires. Votre projet traverse les audits et les essais routiers avec moins de surprises.

Outils de simulation courants utilisés pour le développement et l'essai de véhicules autonomes

Les ingénieurs s'appuient rarement sur une seule pile de logiciels; le choix de la bonne combinaison d'outils accélère la productivité et évite les problèmes d'intégration. Les licences, la maturité de l'écosystème et le soutien de la communauté sont autant d'éléments qui pèsent dans la balance. L'ouverture de la chaîne d'outils influe également sur la rapidité avec laquelle vous pouvez créer des scénarios et collecter des données. Une connaissance pratique des plates-formes dominantes vous protège de l'enfermement.

- NVIDIA DRIVE Sim: Les graphismes haute fidélité restituent des éclairages et des conditions météorologiques complexes, aidant les équipes de perception à tester les réseaux neuronaux. Le couplage étroit avec les accélérateurs CUDA permet de rejouer les capteurs en temps réel.

- CARLA: Les ressources libres vous permettent de contrôler totalement les réseaux routiers et la logique des agents de circulation. Les API Python et les plugins orientés vers l'autonomie raccourcissent les cycles de création de scénarios personnalisés.

- Modèles de simulation automobile dSPACE: Les riches bibliothèques de dynamique de véhicule et de groupe motopropulseur se branchent directement sur les bancs HIL, réduisant ainsi la dépendance vis-à-vis du prototype physique. Les cibles temps réel garantissent la compatibilité temporelle avec les contrôleurs embarqués.

- Boîte à outils MathWorks pour la conduite automatisée: Les flux de travail centrés sur MATLAB permettent le développement et la vérification d'algorithmes dans un cadre numérique familier. Les galeries de scénarios intégrées aident les ingénieurs à satisfaire une couverture basée sur des normes.

- Scénario ANSYS AVxcelerate: Les moteurs de génération statistique élaborent des millions de scénarios paramétrés pour les cas de sécurité. L'évolutivité dans le nuage garantit la régression en une nuit de grandes bases de code.

- Vecteur DYNA4: La dynamique du véhicule, l'émulation de l'interface homme-machine et les bibliothèques d'aide à la conduite s'intègrent à CANoe et CANape pour un test transparent des contrôleurs. Cette exhaustivité simplifie les architectures des chaînes d'outils.

Le choix des outils détermine à la fois la productivité quotidienne et la maintenabilité à long terme. La combinaison de frameworks open-source et de solveurs propriétaires en temps réel permet souvent d'obtenir le meilleur équilibre entre la flexibilité et le support des fournisseurs. Évaluez chaque candidat en fonction des exigences de latence, de la profondeur des scripts et de la longévité de l'écosystème. Vous éviterez ainsi des migrations coûteuses et maintiendrez l'élan de l'innovation.

Simulation en temps réel et en boucle du matériel pour les systèmes de conduite autonome

La principale différence entre la simulation logicielle en temps réel et la validation Hardware-in-the-Loop réside dans la fidélité physique et l'exposition au risque. Les boucles logicielles en temps réel exécutent l'ensemble de l'installation et du contrôleur sur le matériel hôte, testant la logique de l'algorithme dans des conditions de temps déterminées. Le HIL, quant à lui, ne touche pas au contrôleur ou au matériel de détection, remplaçant uniquement le côté usine par des modèles en temps réel, de sorte que les interfaces électriques et temporelles se comportent comme sur la route. Les deux approches partagent des moteurs physiques et des bibliothèques de scénarios cohérents, mais le HIL ajoute le réalisme électrique pour découvrir les interférences électromagnétiques, les problèmes de mise à la terre ou les pics de latence.

| Critère | Logiciel en temps réel | Matériel en boucle |

| Composants physiques présents | Aucun | Matériel du contrôleur, du capteur ou de l'actionneur |

| Contrôle de la tolérance de latence | Horloge logicielle uniquement | Interface électrique et horloge logicielle |

| Risque lors de l'injection d'une faute | Aucun risque de dommage matériel | Risque routier minime mais exposition potentielle au matériel |

| Coût par configuration | Faible, modulable en fonction des licences de calcul | Plus élevé, échelles par accessoires de quincaillerie |

| Stade typique | Validation précoce des algorithmes, régression nocturne | Sécurité fonctionnelle et conformité avant la production |

Le passage de boucles uniquement logicielles à des boucles HIL complètes renforce la confiance car les anomalies électriques, les tolérances des connecteurs et les conflits de bus deviennent visibles. L'investissement est rentabilisé par la réduction du risque de rappel et la diminution de la durée des campagnes d'essais sur le terrain. Les ingénieurs chevronnés commencent souvent par des boucles en temps réel pour affiner rapidement les algorithmes, puis programment des tests HIL ciblés une fois que le code s'est stabilisé. Cette approche progressive permet d'équilibrer la vitesse, le coût et la rigueur.

Défis en matière de simulation de véhicules autonomes et moyens de les relever rapidement

La simulation haute-fidélité résout de nombreux problèmes, mais elle introduit de nouveaux obstacles qui exigent de la prévoyance. Une mauvaise corrélation des modèles, un bruit irréaliste des capteurs et la combinatoire des scénarios peuvent bloquer les projets. Les dépassements de budget apparaissent lorsque la demande de calcul augmente sans avertissement. En connaissant les pièges, vous êtes en mesure de les contrer avant que les calendriers ne dérapent.

- Modèles d'écarts de corrélation: Les modèles physiques en désaccord avec les données de suivi suscitent la méfiance, d'où l'adoption d'un réglage systématique des paramètres et d'une analyse comparative de la réalité sur le terrain.

- Réalisme du bruit des capteurs: Des données synthétiques parfaites masquent les faiblesses des algorithmes, ce qui permet d'injecter des profils de bruit mesurés empiriquement dans les échos lidar et radar.

- Scénario d'explosion: Les permutations non limitées surchargent le calcul des budgets ; l'échantillonnage statistique de l'importance permet de se concentrer sur les arêtes à haut risque.

- Les angles morts de la traçabilité: Les liens trop lâches entre les exigences entraînent des pénalités en cas d'audit ; il convient donc d'intégrer les plates-formes de gestion des essais dès le début.

- Dérive de l'horloge matérielle: Le matériel non synchronisé introduit le non-déterminisme ; déployez des protocoles de temps de précision et surveillez la gigue dans les tableaux de bord.

- L'étalement des permis: Les licences d'outils qui se chevauchent épuisent les budgets ; vérifiez l'utilisation tous les trimestres et consolidez-la si possible.

La plupart des défis sont liés à l'échelle et à la fidélité plutôt qu'à la faisabilité fondamentale. Pour les relever, il faut une gestion rigoureuse des données, une collaboration inter-domaines et un suivi proactif. L'investissement précoce dans la mesure et la surveillance porte ses fruits au fur et à mesure que le nombre de scénarios augmente. L'élan et la crédibilité restent intacts même lorsque le projet prend de l'ampleur.

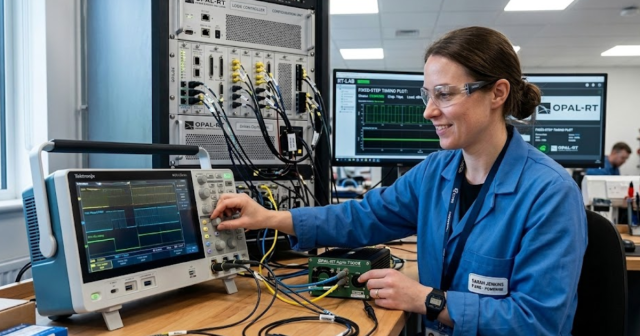

Comment OPAL-RT prend en charge vos flux de simulation de véhicules autonomes

Les simulateurs numériques en temps réel OPAL-RT vous permettent d'intégrer des scénarios multi-capteurs complexes dans des rayons déterministes, en donnant à votre matériel de contrôle la même pression temporelle que celle à laquelle il est confronté sur les routes publiques. Nos solveurs accélérés par FPGA traitent les nuages de points lidar et la dynamique des véhicules à la microseconde, tandis que les API ouvertes se connectent facilement aux bibliothèques Python, MATLAB/Simulink ou FMI, préservant ainsi vos actifs existants. Les ingénieurs apprécient les E/S modulaires qui s'étendent des bancs d'essai aux pistes de test complètes sans réécrire un seul pilote. L'orchestration prête pour le cloud signifie que vous planifiez des suites de régression massives du jour au lendemain, puis téléchargez des mesures exploitables avec la simplicité d'un petit-déjeuner. Nous gardons la configuration audible pour que les auditeurs, les équipes de sécurité et les chefs de file finance fassent confiance aux données.

Les campagnes Hardware-in-the-Loop bénéficient de la latence précise en boucle fermée d'OPAL-RT, ce qui permet de maintenir les minuteries de chien de garde et les interfaces de capteurs dans les limites des enveloppes de certification. Nos boîtes à outils, telles que eHS pour l'électronique de puissance et ARTEMiS pour les solveurs à temps continu, s'associent de manière transparente à des générateurs de scénarios tiers, ce qui vous permet de changer de domaine sans avoir à apprendre de nouvelles syntaxes de script. Vous bénéficiez également d'une assistance technique mondiale qui parle le même dialecte technique que vous, ce qui accélère le dépannage au lieu de le prolonger. Chaque plateforme est assortie d'une tarification transparente, ce qui vous évite des escalades de licence inattendues. Choisissez OPAL-RT pour faire progresser la validation autonome avec confiance, rigueur et un impact mesurable.

Questions courantes

Comment valider mon logiciel de véhicule autonome sans attendre des prototypes physiques ?

Vous pouvez valider les logiciels pour les véhicules autonomes à l'aide d'une simulation haute fidélité qui reproduit les données des capteurs, les scénarios de trafic et les cas limites bien avant que le matériel ne soit disponible. Cela vous permet de vérifier la logique, la synchronisation et les réponses de sécurité dès le début, sans vous engager dans des constructions physiques coûteuses. La simulation fournit également des journaux précis pour chaque essai, ce qui vous aide à répondre aux exigences en matière de documentation et d'audit. OPAL-RT soutient cette approche avec des plates-formes en temps réel qui reproduisent les conditions physiques à l'aide de modèles déterministes, ce qui vous permet de simuler, de tester et de déboguer plus rapidement.

Quelle est la différence entre les tests de Simulation HIL et les tests de logiciels traditionnels dans les projets d'autonomie ?

Les tests logiciels traditionnels vérifient la logique sur des plates-formes statiques ou temporisées, tandis que les tests de Simulation HIL (HIL) connectent le matériel réel du véhicule à des environnements simulés en temps réel. Cette approche vous permet de découvrir les décalages temporels, les défauts des capteurs et les erreurs de protocole qui échappent souvent aux méthodes purement logicielles standard. Le test HIL est essentiel pour vérifier l'intégrité complète du système dans des conditions qui reproduisent le comportement sur route. OPAL-RT vous aide à mener des campagnes HIL avec une grande fidélité grâce à une gestion précise des E/S et à une architecture évolutive.

Pourquoi la couverture de la simulation est-elle si importante pour les essais de véhicules autonomes ?

Les systèmes autonomes doivent prouver qu'ils peuvent gérer en toute sécurité des événements rares, dangereux ou statistiquement improbables qui ne peuvent pas être facilement testés sur la voie publique. La couverture de simulation garantit que votre dossier de sécurité inclut ces conditions limites avec des preuves traçables et des résultats reproductibles. Cet aspect est particulièrement important pour la certification, car les mesures de couverture déterminent souvent les délais d'approbation. Les plateformes OPAL-RT vous permettent de rejouer et de modifier des scénarios à haut risque sur des bancs d'essai test SIL et HIL avec une traçabilité totale des données.

La simulation peut-elle contribuer à réduire mes coûts de développement des véhicules autonomes ?

Oui, la simulation réduit le besoin de tests physiques coûteux, raccourcit les cycles de débogage et permet la réutilisation au sein des équipes et des projets. En détectant les bogues plus tôt et en validant les mises à jour virtuellement, vous évitez les retouches et les retards coûteux. La simulation permet également de développer des flux parallèles, ce qui accélère l'intégration et la préparation des systèmes. La chaîne d'outils ouverte et les solutions évolutives d'OPAL-RT permettent de maintenir l'efficacité de la simulation, même lorsque la complexité augmente.

Comment gérer la complexité des capteurs lors de la création de cadres de simulation autonomes ?

Les données des capteurs peuvent poser des problèmes de latence, de synchronisation et de bande passante lorsque vous simulez des entrées lidar, radar et vision. La gestion de cette complexité nécessite une synchronisation précise, la fidélité du signal et la capacité d'injecter des distorsions de données réalistes. Sans cela, les systèmes de perception peuvent réussir la simulation mais échouer sur la route. OPAL-RT offre des capacités de traitement en temps réel et des E/S modulaires pour simuler ces entrées à large bande passante dans le respect de contraintes temporelles strictes.

EXata CPS a été spécialement conçu pour des performances en temps réel afin de permettre des études de cyberattaques sur les réseaux électriques à travers la couche du réseau de communication de n'importe quelle taille et se connectant à n'importe quel nombre d'équipements pour des simulations HIL et PHIL. Il s'agit d'une boîte à outils de simulation à événements discrets qui prend en compte toutes les propriétés physiques inhérentes qui affecteront le comportement du réseau (câblé ou sans fil).